Was KI an Software-IP geändert hat

KI hat Software-IP nicht ausgelöscht. Sie zwingt Führungskräfte, zwischen Geschäftsgeheimnissen und Code zu untersche...

12 Min. Lesezeit

04.05.2026, Von Stephan Schwab

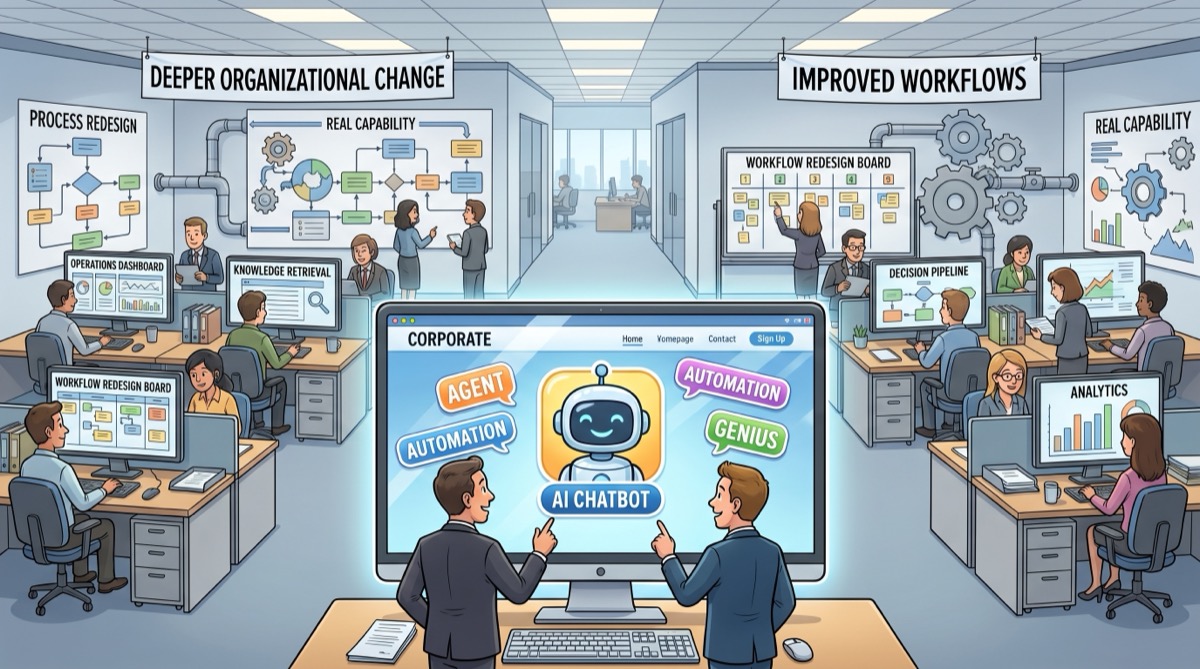

Einen Chatbot auf die Website zu stellen bedeutet noch lange nicht, dass Ihr Unternehmen KI in irgendeinem strategisch relevanten Sinn nutzt. Es bedeutet nur, dass Sie einen Chatbot auf die Website gestellt haben. Dasselbe gilt für Ablaufautomatisierung mit etwas Sprachmodell-Puderzucker obendrauf. Echter KI-Hebel verändert, wie Entscheidungen entstehen, wie Arbeit fließt und was die Organisation leisten kann, was vorher praktisch nicht ging. Dafür muss man erst einmal sauber benennen, was KI überhaupt ist, weil die zwei Buchstaben inzwischen auf fast alles geklebt werden, was blinkt.

Ein Großteil der öffentlichen Diskussion behandelt KI, als wäre sie eine einzige Sache. Ist sie nicht. Das Etikett klebt inzwischen auf einer unordentlichen Mischung von Technologien, die sehr unterschiedliche Aufgaben erfüllen.

Manchmal meint KI ein statistisches Modell, das Abwanderung, Betrug, Nachfrage oder Wartungsrisiken vorhersagt. Manchmal meint es Computer Vision zur Bildklassifikation. Manchmal Empfehlungssysteme, die wahrscheinliche Optionen sortieren. Und manchmal meint es große Sprachmodelle, die Text erzeugen, Dokumente zusammenfassen, Fragen beantworten, Code schreiben oder Arbeit über Werkzeuge hinweg koordinieren.

Diese Systeme haben eines gemeinsam: Sie leiten Muster aus Daten ab und erzeugen Ausgaben, die nicht bloß eine fest verdrahtete Kette von Wenn-dann-Regeln sind. Das macht sie nicht magisch. Es heißt nur, dass sie Problemklassen bewältigen können, bei denen die Welt zu unordentlich für starr handgeschriebene Logik allein ist.

Hier zerfällt die öffentliche Sprache. Die Leute sagen „KI“, wenn sie Automatisierung meinen. Sie sagen „KI“, wenn sie maschinelles Lernen meinen. Sie sagen „KI“, wenn sie einen Chatbot meinen. Sie sagen „KI“, wenn sie ein Anbieter-Zusatzmodul meinen, das höfliche E-Mail-Entwürfe schreibt. Irgendwann sagt der Begriff dann kaum noch etwas.

Für Führungskräfte ist die praktische Definition einfacher: KI ist nützlich, wenn ein System Menschen oder Prozesse dabei unterstützt, mit Mehrdeutigkeit, Mustererkennung, unsauberer Sprache, großen Wissensbeständen oder probabilistischen Entscheidungen so umzugehen, dass sich reale Ergebnisse verändern. Wenn Sie nur eine Gesprächshülle um einen Fragenkatalog gelegt haben, ist Ihr Unternehmen dadurch nicht plötzlich KI-getrieben.

Das ist die erste Trennung, die Führung sauber hinbekommen muss. Ein Chatbot ist eine Oberfläche. KI-Einsatz ist eine operative Fähigkeit.

Ein Chatbot kann nützlich sein. Er kann einfachen Support entlasten, Anfragen routen, Leads einsammeln oder wiederkehrende Fragen beantworten. Schön. Nichts davon beweist, dass Ihr Unternehmen spürbar verändert hat, wie es lernt, entscheidet, liefert oder Kunden bedient.

Ein Hilfs-Widget, das Versandfragen beantwortet, ist nicht dasselbe wie KI für bessere Preisentscheidungen, schnellere Angebotserstellung, das Erkennen von Fehlermustern, den Zugriff auf internes Wissen, besseres Onboarding oder bessere Entscheidungen mit weniger Verzögerung.

Das eine ist eine Funktion. Das andere ist eine Fähigkeit.

Zu viele Unternehmen kaufen die Funktion und verkünden die Fähigkeit.

Diese Verwechslung ist älter als die aktuelle KI-Welle. Seit Jahren automatisieren Unternehmen Formularrouten, Rechnungsverarbeitung, Benachrichtigungen, CRM-Updates, Ticket-Zuweisung und Freigabeketten. Nützliche Arbeit. Mitunter sehr nützliche Arbeit.

Aber Automatisierung und KI sind keine austauschbaren Begriffe.

Klassische Automatisierung besteht aus vordefinierten Schritten: Wenn das passiert, dann mach dies. Route diese Anfrage. Kopiere jenes Feld. Sende diese E-Mail. Verschiebe diesen Datensatz. So sinkt der manuelle Aufwand in wiederholbaren Prozessen.

KI wird dort interessant, wo die Arbeit Mehrdeutigkeit, Mustererkennung, Zusammenfassung, Informationsabruf, Priorisierung, Generierung, probabilistische Urteile oder den Umgang mit chaotischer menschlicher Sprache und chaotischem menschlichem Kontext enthält.

Selbst dann ist nicht jede KI-Nutzung wertvoll. Ein schlecht platziertes Sprachmodell kann nichts weiter sein als ein teurer Zufallstextgenerator, der an einen Prozess geklebt wurde, der vorher stabil war.

Nein, der Kauf von Automatisierungswerkzeugen bedeutet nicht automatisch, dass Ihr Unternehmen das nutzt, was KI tatsächlich anbieten kann. Vielleicht haben Sie nur die Rohrleitungen modernisiert.

Viel von der aktuellen KI-Sprache ist Verkaufssprache, keine Betriebssprache.

Plötzlich hat jedes Ablaufwerkzeug Agenten. Jeder Chatbot ist intelligent. Jeder Assistent ist autonom. Jede Regel-Engine wurde mit dramatischerem Namen und größerer Rechnung neu geboren.

Das ist normales Anbieterverhalten. Das Problem beginnt dort, wo Führungskräfte Kategorien-Inflation mit echter Fähigkeit verwechseln.

Wenn ein Anbieter sagt, er liefere „KI-Agenten“, fragen Sie, was das Ding konkret tut.

Das sind keine semantischen Details. Das ist der Unterschied zwischen dem Kauf eines Etiketts und dem Kauf einer Fähigkeit.

Dasselbe gilt für interne Politik. „KI“ auf einen Roadmap-Punkt zu kleben, ist ein einfacher Weg, modern auszusehen, ohne viel zu verändern. Ein Chatbot-Start macht sich gut auf Folien. Prozessneugestaltung nicht. Das eine bekommt Applaus. Das andere schafft dauerhaften Vorteil.

Das Wort „Agent“ eignet sich besonders gut für diese Inflation, weil es eine Geschichte mitschmuggelt. Das Wort lässt Software wie einen verantwortlichen Akteur mit Zielen, Initiative und Urteilskraft klingen. Diese Rahmung ist kommerziell praktisch. Sie hebt aber auch still die Erwartungen weit über das hinaus, was die meisten dieser Systeme tatsächlich leisten.

Wenn Führung wissen will, ob das Unternehmen KI wirklich gut nutzt, sollte sie nicht auf die Demo starren, sondern auf das Betriebsmodell.

Echter Hebel zeigt sich meist an Stellen wie diesen:

Was haben diese Beispiele gemeinsam? Es geht nicht primär um einen öffentlich sichtbaren Gimmick. Es geht darum, wie die Organisation arbeitet.

Das ist die nützliche Frage: Wo hat KI die Reichweite des Unternehmens vergrößert?

Hat sie Ihren Leuten geholfen, bessere Entscheidungen zu treffen? Hat sie Verzögerung reduziert? Hat sie die Kosten im Umgang mit Komplexität gesenkt? Hat sie Qualität unter realen Betriebsbedingungen verbessert? Hat sie etwas ermöglicht, das vorher unpraktisch war?

Wenn die Antwort nein lautet, haben Sie vielleicht KI-aromierte Dekoration gekauft.

Führungsteams stehen unter Druck, Bewegung zu zeigen. Aufsichtsgremien fragen nach KI. Investoren fragen nach KI. Kunden fragen nach KI. Plötzlich braucht jede Vorstandsfolie einen Beleg dafür, dass das Unternehmen nicht schläft.

Ein Chatbot ist praktisch, weil man leicht darauf zeigen kann.

„Da. Wir haben KI gemacht.“

Dieser Satz bedient genau den falschen Instinkt in der Organisation. Er belohnt Sichtbarkeit statt Substanz. Er verwechselt kundenorientierte Neuheit mit interner Fähigkeit. Er macht aus einer strategischen Frage eine Branding-Übung.

Währenddessen liegt die härtere Arbeit im Hintergrund: Wissenszersplitterung beheben, Abläufe neu schneiden, nützliche Daten freilegen, Feedback-Schleifen etablieren, Führung schärfen und herausfinden, wo probabilistische Systeme helfen und wo sie neue Risiken erzeugen.

Diese Arbeit ist weniger glamourös. Dort sitzt aber der Wert.

Wenn Sie das Theater durchschneiden wollen, stellen Sie einen kurzen Satz brutaler Fragen:

Diese Fragen zwingen das Gespräch zurück zu Ergebnissen.

Eine ernsthafte KI-Initiative sollte verändern, wie Arbeit durch das Unternehmen fließt. Sie sollte Evidenz erzeugen. Sie sollte Grenzen, Verantwortung und sichtbare Zielkonflikte haben. Sie sollte nicht allein vom Applaus leben.

Das ist die nützliche Definition. Kein digitaler Kollege. Kein Maschinen-Mitarbeiter. Kein synthetischer Vorstand. Nur Software mit etwas mehr Initiative als ein Einmal-Befehl.

In der Praxis machen die meisten sogenannten Agenten eine Mischung aus diesen Dingen:

Das kann nützlich sein. Es ist aber deutlich schmaler als die öffentliche Geschichte rund um das Wort.

Das wichtige technische Detail, in normaler Sprache erklärt, lautet: Das große Sprachmodell selbst ist in der Regel zustandslos. Es wacht morgens nicht auf und erinnert sich an Ihr Unternehmen, Ihren Kunden oder das letzte Meeting. Bei jedem Aufruf bekommt es ein Paket aus Kontext und erzeugt eine Antwort. Dann ist dieser Moment vorbei.

Was das System kontinuierlich wirken lässt, ist die gewöhnliche Software um das Modell herum.

Diese umgebende Software lässt den „Agenten“ so aussehen, als würde er sich erinnern, planen und über Zeit handeln. Das Modell liefert Sprache und Mustererkennung. Der Rest ist normale Software: Speicherung, Informationsabruf, Orchestrierung, Berechtigungen, Protokollierung und Benutzeroberfläche.

Das ist wichtig, weil es den Zaubertrick entlarvt. Wenn jemand sagt: „Der Agent kennt unser Geschäft“, meint er meist nur, dass ein konventioneller Software-Stack die relevanten Informationen geholt und sie im richtigen Moment an ein zustandsloses Modell übergeben hat.

Warum Anbieter „Agent“ lieben, ist einfach: Es klingt nach einer Arbeitseinheit. Es suggeriert Initiative, Delegation und Entlastung. Es flüstert, man könne Software kaufen, statt Prozesse zu reparieren, Menschen zu schulen oder Fähigkeiten aufzubauen. Darum verbreitet sich das Label schneller als die Realität.

Wenn Sie für diese Art Verwirrung einen breiteren Führungsrahmen wollen, lesen Sie warum nicht-technische Führungskräfte Software-Komplexität ständig unterschätzen. Genau derselbe Fehler taucht auch hier auf: Menschen verwechseln eine sichtbare Oberfläche mit dem tieferen System darunter.

Das ist keine Dummheit. Das ist normale menschliche Wahrnehmung.

Menschen anthropomorphisieren. Wir schreiben allem Handlungsmacht, Absicht, Sicherheit und Kompetenz zu, was sich wie ein sozialer Akteur verhält. Ein System, das in ganzen Sätzen antwortet, sich an Teile eines Gesprächs erinnert und scheinbar von selbst handelt, löst genau diese Reaktion aus. Der alte ELIZA-Effekt ist nie verschwunden. Die Modelle sind nur besser darin geworden, ihn auszulösen.

Und weil der erinnerungsähnliche Teil durch umgebende Software zusammengenäht wird, wird die Illusion stärker. Der Nutzer sieht Kontinuität. Er sieht nicht den Datenbankabruf, die Zusammenstellung der Eingabe, den Abrufschritt, die Richtlinienprüfungen oder die Ablaufsteuerung hinter dem Vorhang. Er sieht eine flüssige Oberfläche und unterstellt einen kohärenten Geist.

Das ist wichtig, weil Wahrnehmung Entscheidungen verändert. Sobald Führung beginnt, ein Werkzeug als Quasi-Person zu sehen, stellt sie die falschen Fragen. Sie fragt nicht mehr, wozu das System begrenzt ist, sondern was es „weiß“. Sie fragt nicht mehr, wo es scheitert, sondern wie viele Menschen es ersetzen kann. Sie bewertet kein Werkzeug mehr, sondern imaginiert einen Mitarbeiter.

Darum wird agentisches Coding auch so aggressiv vermarktet. Eine Demo, in der Software Dateien liest, einen Plan vorschlägt, Code schreibt und einen Pull Request öffnet, erzeugt einen starken psychologischen Eindruck von Autonomie. Es wirkt wie ein Entwickler, der nie müde wird und nie eine Rechnung schickt.

Aber die Wahrnehmung erledigt einen großen Teil der Arbeit. Was Sie oft sehen, ist ein probabilistisches System in einer eng gerahmten Umgebung mit Werkzeugen, Eingaben, Wiederholungsversuchen und vorbereiteten Leitplanken. Nützlich? Oft. Unabhängig im menschlichen Sinn? Nein.

Agentisches Coding bedeutet meist, einem Modell ein Programmierziel zu geben plus Zugriff auf Code, Tests, Terminals, Werkzeuge und genug Schleifensteuerung, damit es prüfen, ändern, ausführen und überarbeiten kann, ohne für jeden Schritt um Erlaubnis zu fragen.

Auch hier kommt die scheinbare Autonomie mindestens so sehr aus der Hülle wie aus dem Modell. Das Programmierwerkzeug speichert die Aufgabe, verfolgt Dateien, wählt den zu sendenden Kontext, entscheidet über verfügbare Werkzeuge, hält Kommandoausgaben fest, hält die Schleife am Laufen und präsentiert das Ergebnis so, als hätte eine einzige Entität den ganzen Faden getragen. Das Sprachmodell ist eine Komponente dieses Systems, nicht das ganze System.

Diese Unterscheidung ist für Käufer und Führungskräfte wichtig, weil sie zeigt, wo die eigentliche Arbeit sitzt. Wenn die umgebende Software schwach ist, wird auch der „Agent“ schwach sein. Wenn der umgebende Prozess kaputt ist, erbt der „Agent“ die Bruchstellen. Über dem Rest des Stacks schwebt keine Magie.

Das ist eine bedeutsame Veränderung im Werkzeugkasten. Es kann Zeit sparen. Es kann Reibung senken. Es kann repetitive Arbeit wegfräsen und Optionen schnell sichtbar machen.

Es ist nicht dasselbe wie der Ersatz von Software-Entwicklung durch autonome Magie.

Der Programmieragent erbt weiterhin die Qualität der Umgebung um ihn herum. Schwache Tests, vage Ziele, fragmentierte Architektur, schlechte Daten, schlampige Reviews und fehlende Entwurfsdisziplin verschwinden nicht. Der Agent bewegt sich nur schneller durch dieses Chaos. Manchmal sehr viel schneller.

Darum ist das Verkaufsnarrativ für agentisches Coding oft psychologisch brillant und operativ unredlich. Es verkauft das Bild eines selbstgesteuerten Bauers und hängt gleichzeitig an menschlich gesetzten Grenzen, menschlich gehaltenem Kontext und menschlichem Urteil auf jeder Ebene, die wirklich zählt.

Ein Agent ist kein Urteilsvermögen. Er ist keine Verantwortung. Er ist kein organisatorisches Gedächtnis. Er ist keine Strategie. Er ersetzt weder saubere Daten noch kohärente Prozesse noch kompetente Führung.

Wenn Ihr Prozess kaputt ist, hilft ein Agent Ihnen vielleicht, ihn schneller kaputt zu machen. Wenn Ihre Daten fragmentiert sind, erbt der Agent diese Fragmentierung. Wenn Ihre Teams den Ausgaben nicht vertrauen, stirbt die glänzende Demo in der Produktionsrealität wie jedes andere ungeliebte Werkzeug.

Das ist der unangenehme Test.

Nehmen Sie den Chatbot weg. Nehmen Sie das KI-Branding weg. Nehmen Sie die Anbieterpräsentation und die Startankündigung weg. Was hat sich dann tatsächlich verändert?

Hat das Unternehmen schneller gelernt? Hat es Koordinationsreibung reduziert? Haben Teams mit weniger Warten bessere Entscheidungen getroffen? Haben Kunden eine wirklich bessere Erfahrung bekommen? Hat das Unternehmen Arbeit erschlossen, die vorher zu langsam, zu teuer oder zu chaotisch war?

Wenn ja, gut. Dann nutzen Sie KI wahrscheinlich für etwas Reales.

Wenn nein, dann nutzt das Unternehmen KI vielleicht noch in keiner strategisch relevanten Weise. Vielleicht leiht es sich nur das Kostüm.

Das ist kein moralisches Versagen. Man sollte es nur ehrlich benennen. Sobald Sie aufhören zu behaupten, der Chatbot sei die Strategie, können Sie nach den Stellen suchen, an denen KI tatsächlich zählt.

Und sobald Sie aufhören, Anbietersprache für Strategie zu halten, können Sie die einzige Frage stellen, die wirklich zählt: Was hat sich im Geschäft verändert, das auch dann noch zählen würde, wenn der Glanz der Demo verflogen ist?

Sprechen wir über Ihre reale Situation. Möchten Sie Auslieferung beschleunigen, technische Blockaden beseitigen oder prüfen, ob eine Idee mehr Investition verdient? Ich höre Ihren Kontext und gebe 1-2 praktische Empfehlungen. Ohne Pitch, ohne Verpflichtung. Vertraulich und direkt.

Zusammenarbeit beginnenSichtbarkeit und Umsetzungskraft

Navigator liefert deiner Führungsebene klare Einblicke in Muster, Blockaden und Kapazität. Unser Developer Advocate schreibt produktiven Code mit deinem Team und bringt die Auslieferung in Fahrt.