Lo que la IA cambió en la PI del software

La IA no borró la PI del software. Obligó a separar secretos comerciales y deberes de confidencialidad de código que ...

14 min de lectura

04.05.2026, Por Stephan Schwab

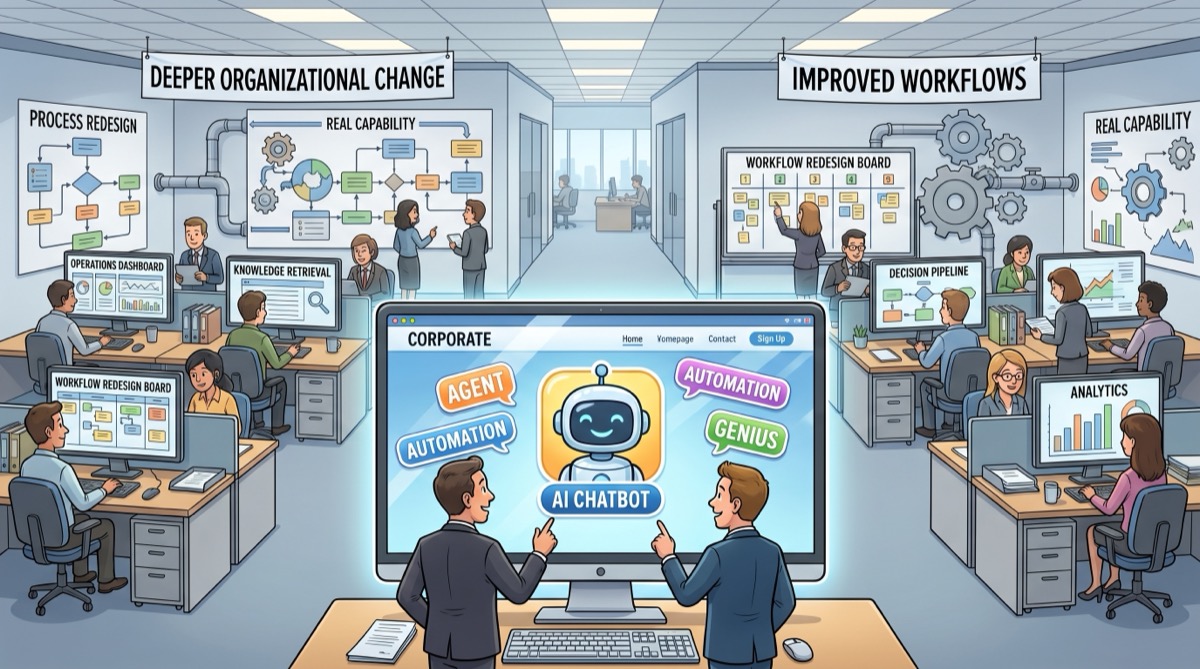

Poner un chatbot en su sitio web no significa que su empresa esté usando IA de una forma estratégicamente relevante. Significa que puso un chatbot en su sitio web. Lo mismo vale para la automatización de flujos con un poco de polvo de modelo de lenguaje encima. El verdadero apalancamiento de la IA cambia cómo se toman decisiones, cómo fluye el trabajo y qué puede hacer la organización que antes no podía hacer de manera práctica. Eso empieza por nombrar qué es realmente la IA, porque esas dos letras ya se pegan a casi cualquier cosa que parpadea.

Buena parte de la conversación pública trata la IA como si fuera una sola cosa. No lo es. La etiqueta ahora cubre una mezcla desordenada de tecnologías que hacen trabajos muy distintos.

A veces IA significa un modelo estadístico que predice fuga de clientes, fraude, demanda o riesgo de mantenimiento. A veces significa visión por computador clasificando imágenes. A veces significa sistemas de recomendación que ordenan opciones probables. Y a veces significa grandes modelos de lenguaje que generan texto, resumen documentos, responden preguntas, escriben código o coordinan trabajo entre herramientas.

Esos sistemas tienen una cosa en común: infieren patrones a partir de datos y producen salidas que no son solo una cadena codificada a mano de reglas si-entonces. Eso no los vuelve mágicos. Solo significa que pueden manejar clases de problemas donde el mundo es demasiado desordenado para depender únicamente de lógica rígida escrita a mano.

Aquí es donde el lenguaje público se cae a pedazos. La gente dice “IA” cuando quiere decir automatización. Dice “IA” cuando quiere decir aprendizaje automático. Dice “IA” cuando quiere decir chatbot. Dice “IA” cuando quiere decir un añadido de proveedor que redacta correos educados. Para ese punto el término ya tiene tantos significados que deja de decir mucho.

Para quienes lideran, la definición práctica es más simple: la IA es útil cuando un sistema ayuda a personas o procesos a lidiar con ambigüedad, reconocimiento de patrones, lenguaje confuso, grandes conjuntos de conocimiento o decisiones probabilísticas de una forma que cambia resultados reales. Si lo único que hizo fue poner una envoltura conversacional alrededor de una lista de preguntas frecuentes, su empresa no se volvió de pronto una empresa impulsada por IA.

Esta es la primera separación que liderazgo necesita hacer. Un chatbot es una superficie. La adopción de IA es una capacidad operativa.

Un chatbot puede ser útil. Puede reducir carga simple de soporte, enrutar consultas, captar leads o responder preguntas repetitivas. Bien. Nada de eso prueba que su empresa haya cambiado de forma significativa cómo aprende, decide, entrega o atiende a clientes.

Un widget de ayuda que responde preguntas de envío no es lo mismo que usar IA para mejorar decisiones de precio, acelerar propuestas, detectar patrones de fallo, recuperar conocimiento interno, mejorar onboarding de clientes o ayudar a equipos a tomar mejores decisiones con menos demora.

Una cosa es una funcionalidad. La otra es una capacidad.

Demasiadas empresas compran la funcionalidad y anuncian la capacidad.

Esta confusión es más vieja que la ola actual de IA. Durante años, las empresas automatizaron ruteo de formularios, manejo de facturas, notificaciones, actualizaciones en CRM, asignación de tickets y cadenas de aprobación. Trabajo útil. A veces muy útil.

Pero automatización e IA no son ideas intercambiables.

La automatización clásica trata de pasos predefinidos: si pasa esto, haga aquello. Enrute esta solicitud. Copie ese campo. Dispare este correo. Mueva ese registro. Reduce esfuerzo manual en procesos repetibles.

La IA se vuelve interesante cuando el trabajo implica ambigüedad, reconocimiento de patrones, resumen, recuperación, priorización, generación, juicio probabilístico o interacción con lenguaje humano desordenado y contexto humano desordenado.

Incluso entonces, no todo uso de IA tiene valor. Un modelo de lenguaje mal colocado puede no ser más que un generador caro de texto aleatorio pegado a un proceso que antes era estable.

Así que no, comprar herramientas de automatización no significa automáticamente que su empresa esté aprovechando lo que la IA realmente puede ofrecer. Tal vez solo modernizó la plomería.

Mucho del lenguaje actual sobre IA es lenguaje de ventas, no lenguaje operativo.

De pronto toda herramienta de flujo de trabajo tiene agentes. Todo chatbot es inteligente. Todo asistente es autónomo. Todo motor de reglas renació con un nombre más dramático y una factura más grande.

Ese es comportamiento normal de proveedor. El problema empieza cuando liderazgo confunde inflación de categorías con capacidad real.

Si un proveedor dice que ofrece “agentes de IA”, pregunte qué hace concretamente la cosa.

Eso no son detalles semánticos. Esa es la diferencia entre comprar una etiqueta y comprar una capacidad.

Lo mismo vale para la política interna. Pegar “IA” a un punto del roadmap es una manera fácil de parecer actual sin cambiar gran cosa. Un lanzamiento de chatbot luce bien. El rediseño de procesos no. Una cosa recibe aplauso. La otra crea ventaja duradera.

La palabra “agente” es especialmente útil para este tipo de inflación porque mete de contrabando una historia. Hace que el software suene como un actor responsable con metas, iniciativa y criterio. Ese encuadre es comercialmente conveniente. También eleva silenciosamente las expectativas mucho más allá de lo que la mayoría de estos sistemas puede hacer de verdad.

Si liderazgo quiere saber si la empresa realmente está usando bien la IA, tiene que dejar de mirar la demo y mirar el modelo operativo.

El apalancamiento real suele aparecer en lugares como estos:

Fíjese en lo que estos ejemplos tienen en común. No tratan principalmente de un truco visible de cara al público. Tratan de cambiar cómo funciona la organización.

Esa es la pregunta útil: ¿dónde aumentó la IA el rango de la empresa?

¿Ayudó a su gente a tomar mejores decisiones? ¿Redujo demoras? ¿Bajó el costo de lidiar con complejidad? ¿Mejoró calidad bajo condiciones operativas reales? ¿Hizo posible algo que antes era impráctico?

Si la respuesta es no, quizá compró decoración con sabor a IA.

Los equipos de liderazgo están bajo presión para mostrar movimiento. Los consejos preguntan por IA. Los inversionistas preguntan por IA. Los clientes preguntan por IA. De pronto toda presentación ejecutiva necesita una diapositiva que pruebe que la empresa no está dormida.

Un chatbot es conveniente porque es fácil de señalar.

“Ahí. Hicimos IA.”

Esa frase halaga exactamente el instinto equivocado dentro de la organización. Recompensa visibilidad por encima de sustancia. Confunde novedad de cara al cliente con capacidad interna. Convierte una pregunta estratégica en un ejercicio de marca.

Mientras tanto, el trabajo duro queda al fondo: arreglar fragmentación de conocimiento, rediseñar flujos de trabajo, exponer datos útiles, establecer bucles de retroalimentación, endurecer la gobernanza y averiguar dónde ayudan los sistemas probabilísticos y dónde introducen riesgo fresco.

Ese trabajo es menos glamoroso. También es donde vive el valor.

Si quiere cortar el teatro, haga un conjunto corto de preguntas brutales:

Esas preguntas fuerzan la conversación a volver a los resultados.

Una iniciativa seria de IA debería cambiar cómo fluye el trabajo por la empresa. Debería producir evidencia. Debería tener límites, responsables y compensaciones visibles. No debería sobrevivir solo de aplausos.

Esa es la definición útil. No un colega digital. No un empleado máquina. No un ejecutivo sintético. Solo software con un poco más de iniciativa que un comando de un solo tiro.

En la práctica, la mayoría de los llamados agentes hacen alguna mezcla de estas cosas:

Eso puede ser útil. También es bastante más estrecho que la historia pública construida alrededor de la palabra.

El detalle técnico importante, explicado en lenguaje normal, es que el gran modelo de lenguaje suele ser sin estado. No se despierta por la mañana recordando su empresa, su cliente o la última reunión. Cada vez que se invoca recibe un paquete de contexto y produce una respuesta. Luego ese momento se termina.

Lo que hace que el sistema parezca continuo es el software ordinario que envuelve al modelo.

Ese software alrededor es lo que hace que el “agente” parezca recordar, planificar y actuar a lo largo del tiempo. El modelo aporta lenguaje e inferencia de patrones. El resto es software normal: almacenamiento, recuperación, orquestación, permisos, registro e interfaz de usuario.

Importa porque atraviesa el truco de magia. Cuando alguien dice “el agente conoce nuestro negocio”, normalmente lo que quiere decir es que una pila de software convencional recuperó la información relevante y se la entregó a un modelo sin estado en el momento oportuno.

La razón por la que a los proveedores les encanta “agente” es simple: suena como una unidad de trabajo. Sugiere iniciativa, delegación y alivio. Susurra que quizá pueda comprar software en lugar de arreglar procesos, formar gente o construir capacidad. Por eso la etiqueta se propaga más rápido que la realidad.

Si quiere una mirada más amplia de liderazgo sobre este tipo de confusión, lea por qué los líderes no técnicos siguen subestimando la complejidad del software. El mismo error aparece aquí: la gente confunde una superficie visible con el sistema más profundo que hay debajo.

Eso no es estupidez. Es percepción humana normal.

La gente antropomorfiza. Atribuimos agencia, intención, seguridad y competencia a cualquier cosa que se comporte como actor social. Un sistema que responde con frases completas, recuerda parte de una conversación y parece actuar por su cuenta dispara exactamente esa reacción. El viejo efecto ELIZA nunca se fue. Los modelos solo se volvieron mejores provocándolo.

Y como la parte que parece memoria está cosida con software alrededor, la ilusión se vuelve más fuerte. El usuario ve continuidad. No ve la consulta a la base de datos, el armado de la instrucción, el paso de recuperación, los controles de política o el motor del proceso detrás del telón. Ve una sola superficie fluida y asume una sola mente coherente.

Eso importa porque la percepción cambia la toma de decisiones. En cuanto liderazgo empieza a ver una herramienta como una cuasi persona, hace las preguntas equivocadas. Deja de preguntar para qué está acotado el sistema y empieza a preguntar qué “sabe”. Deja de preguntar dónde falla y empieza a preguntar a cuánta gente puede reemplazar. Deja de evaluar una herramienta y empieza a imaginar un trabajador.

Por eso la programación agéntica se vende con tanta agresividad. Una demo que muestra software leyendo archivos, proponiendo un plan, escribiendo código y abriendo un pull request crea una impresión psicológica muy fuerte de autonomía. Parece un desarrollador que nunca se cansa y nunca manda factura.

Pero la percepción está haciendo buena parte del trabajo ahí. Lo que muchas veces está viendo es un sistema probabilístico operando dentro de un entorno estrechamente encuadrado con herramientas, instrucciones, reintentos y barandillas preparadas de antemano. ¿Útil? A menudo. ¿Independiente en el sentido humano? No.

La programación agéntica suele significar darle a un modelo un objetivo de programación más acceso a código, pruebas, terminales, herramientas y suficiente control en bucle para inspeccionar, cambiar, ejecutar y revisar sin pedir permiso en cada paso.

Aquí también, la autonomía aparente viene tanto del envoltorio como del modelo. La herramienta de programación guarda la tarea, rastrea archivos, decide qué contexto enviar, decide qué herramientas están disponibles, captura la salida de comandos, mantiene vivo el bucle y presenta el resultado como si una sola entidad hubiera llevado todo el hilo. El modelo de lenguaje es un componente de ese sistema, no el sistema entero.

Esa distinción importa para compradores y líderes porque muestra dónde está el trabajo real. Si el software alrededor es débil, el “agente” será débil. Si el proceso alrededor está roto, el “agente” heredará la rotura. No hay una capa mágica flotando por encima del resto del stack.

Eso es un cambio significativo en herramientas. Puede ahorrar tiempo. Puede reducir fricción. Puede triturar trabajo repetitivo y exponer opciones rápidamente.

No es lo mismo que reemplazar el desarrollo de software con magia autónoma.

El agente de programación sigue heredando la calidad del entorno que lo rodea. Pruebas débiles, objetivos vagos, arquitectura fragmentada, datos malos, revisión descuidada y disciplina de diseño ausente no desaparecen. El agente solo se mueve por ese desorden más rápido. A veces mucho más rápido.

Por eso el discurso de venta de la programación agéntica suele ser psicológicamente brillante y operativamente deshonesto. Vende la imagen de un constructor autodirigido mientras depende silenciosamente de límites creados por humanos, contexto en manos humanas y juicio humano en cada capa que de verdad importa.

Un agente no es juicio. No es responsabilidad. No es memoria organizativa. No es estrategia. No reemplaza datos limpios, procesos coherentes ni liderazgo competente.

Si su proceso está roto, un agente quizá le ayude a romperlo más rápido. Si sus datos están fragmentados, el agente heredará esa fragmentación. Si sus equipos no confían en los resultados, la demo brillante morirá en la realidad de producción como cualquier otra herramienta que nadie quiere.

Esa es la prueba incómoda.

Quite el chatbot. Quite la marca de IA. Quite la presentación del proveedor y el anuncio del lanzamiento. ¿Qué cambió realmente?

¿La empresa aprendió más rápido? ¿Redujo fricción de coordinación? ¿Los equipos tomaron mejores decisiones con menos espera? ¿Los clientes obtuvieron una experiencia genuinamente mejor? ¿El negocio desbloqueó trabajo que antes era demasiado lento, demasiado caro o demasiado desordenado?

Si sí, bien. Probablemente está usando IA para algo real.

Si no, entonces puede que la empresa todavía no esté usando IA de una manera estratégicamente significativa. Puede que solo esté alquilando el disfraz.

Eso no es un fallo moral. Solo conviene nombrarlo con honestidad. En cuanto deja de fingir que el chatbot es la estrategia, puede empezar a buscar los lugares donde la IA de verdad importa.

Y cuando deja de tratar el lenguaje de los proveedores como si fuera estrategia, puede hacer la única pregunta que importa: ¿qué cambió en el negocio que seguiría importando después de que se apague el brillo de la demo?

Hablemos de tu situación real. ¿Quieres acelerar la entrega, quitar bloqueos técnicos o validar si una idea merece más inversión? Escucho tu contexto y te doy 1-2 recomendaciones prácticas. Sin compromiso ni discurso comercial. Confidencial y directo.

Empecemos a trabajar juntosVisibilidad y capacidad de ejecución

Navigator ofrece a tus ejecutivos una visión clara de patrones, bloqueos y capacidad. Nuestro Developer Advocate programa código productivo con tu equipo y acelera la entrega.